| Graph Convolutional Networks with EigenPooling 论文阅读 | 您所在的位置:网站首页 › artery vein 组合 › Graph Convolutional Networks with EigenPooling 论文阅读 |

Graph Convolutional Networks with EigenPooling 论文阅读

|

Graph Convolutional Networks with EigenPooling 论文阅读

摘要简介框架 EigenGCN实验

摘要

近年来,将深度神经网络模型概括为结构化数据的图形神经网络吸引了越来越多的关注。他们通常通过变换,传播和聚合节点特征来学习节点表示,并已被证明可以改善许多图形相关任务的性能,例如节点分类和链接预测。为了将图神经网络应用于图分类任务,需要从节点表示生成图表示的方法。一种常见的方法是全局组合节点表示。但是,丰富的结构信息被忽略了。因此,在图表示学习期间,需要分层池化过程来保留图结构。最近有一些关于分层学习图表示的工作,类似于传统的卷积神经(CNN)网络中的合并步骤。但是,在合并过程中,本地结构信息仍然被很大程度上忽略。在本文中,我们引入了基于图傅立叶变换的池化算符EigenPooling,该池算子可以在池化过程中利用节点特征和局部结构。然后,我们基于池化算子设计池化层,将池化层进一步与传统GCN卷积层组合以形成用于图分类的图神经网络框架EigenGCN。提供理论分析以从本地和全局角度了解EigenPooling。图分类任务在6个常用基准上的实验结果证明了所提出框架的有效性。 简介现有方法的局限性: 目前,有很多神经网络的方法应用在图结构化的数据上,且对节点分类、链接预测等任务都有改进,而这些用于图表示学习的方法主要促进了图分类。在本文中,我们致力于图级表示学习(graph level representation learning),重点是图分类的任务。 图神经网络在使用所有相关信息来提取出图表示。 本文中的几个难点: 1)子图可能包含不同数量的节点,因此固定大小的池运算符无法对所有子图起作用。 2)子图可能具有不同的结构,这可能需要不同的方法来汇总有关超节点表示的信息。 本文主要贡献: •我们介绍了一种新颖的池化运算符EigenPooling,它可以在利用子图结构的同时自然地汇总子图信息。 •我们从局部和全局角度提供有关EigenPooling的理论理解; •我们将基于EigenPooling的池化层整合到现有的图神经网络中,作为一种新颖的框架EigenGCN进行图表示的学习。 •我们在大量真实图分类上进行了全面的实验,以证明拟议的池算子的有效性。 框架 EigenGCN问题设置: GCN模型是针对节点表示学习的,GCN的输出结果是一个矩阵,GCN的过程是flat的,可以pass message ,但是不能总结节点的信息到一个更高层面的图表示上去,一个简单的方法就是图池化,总结节点信息生成图级表示学习。例如,我们可以使用节点表示的均值作为图表示,但是这种方法在池化过程中忽略了很多关键信息和图结构信息。 为了解决上述难题,我们基于池化层EigenPooling去总结节点信息,并生成图表示,如图1,在卷积层中间添加一个池化层,每个池化层将一个图上定义的图信号合并为输入图的粗化版本中定义的图信号,该输入信号由较少的节点组成。 因此,池化层由两部分组成:①图粗化:把图划分为多个子图,通过将子图看做一个超节点得到一个粗化图②使用EigenPooling将原始图信号信息转换为在粗化图上定义的图信号。 图粗化:

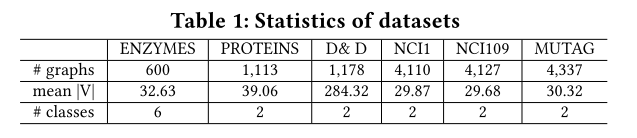

A(k)是子图的邻接矩阵(不是NxN大小的) Aint是 NxN大小的子图的邻接矩阵。Aext是子图间的邻接矩阵。 Eigenvector-Based Pooling – EigenPooling (这一部分看的不是很明白,因为图傅里叶转换还没搞懂,暂时不写了,避免误导) 实验这一节主要回答了两个问题: 1、EigenGCN通过设计EgienPooling能提高图分类的性能吗? 2、使用H个过滤器进行池化可靠? 1、数据集:

|

【本文地址】

An Overview of EigenGCN

An Overview of EigenGCN  公式1是GCN中的公式(具体可去看GCN)

公式1是GCN中的公式(具体可去看GCN) 上图是论文中的符号定义(符号编辑太麻烦我就不重新写一遍了,很好理解的。)

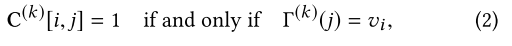

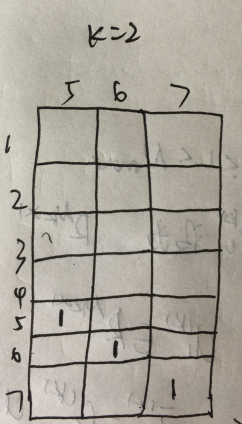

上图是论文中的符号定义(符号编辑太麻烦我就不重新写一遍了,很好理解的。)  公式2是子图跟原图的关联的一个矩阵,我粗略画了一个图可参考。

公式2是子图跟原图的关联的一个矩阵,我粗略画了一个图可参考。  上图是一个原始图,可划分为两个子图,分别为子图1 和子图2

上图是一个原始图,可划分为两个子图,分别为子图1 和子图2 上图是C(k),根据公式2对子图2得到的矩阵。

上图是C(k),根据公式2对子图2得到的矩阵。

公式7就得到了粗化图的邻接矩阵。C(k)就是一个上采样操作。

公式7就得到了粗化图的邻接矩阵。C(k)就是一个上采样操作。 2、图分类性能 表2是图分类结果: 1)、与没有分层的池化方法相比,Diff-pool和EigenGCN效果更好。 2)、提出的框架EigenGCN与GCN、GraphSage、SET2SET共享卷积层,但对于大部分数据集,EigenGCN性能更优。这也说明了分层池化的重要性。 3)、对于大部分数据集,EigenGCN方法有更多特征向量的性能比较少特征向量的性能更好一些。 4)、提出的EigenGCN在所有数据集上均达到了最新水平或至少具有可比性的性能,表明了提出的EigenGCN框架具有有效性。

2、图分类性能 表2是图分类结果: 1)、与没有分层的池化方法相比,Diff-pool和EigenGCN效果更好。 2)、提出的框架EigenGCN与GCN、GraphSage、SET2SET共享卷积层,但对于大部分数据集,EigenGCN性能更优。这也说明了分层池化的重要性。 3)、对于大部分数据集,EigenGCN方法有更多特征向量的性能比较少特征向量的性能更好一些。 4)、提出的EigenGCN在所有数据集上均达到了最新水平或至少具有可比性的性能,表明了提出的EigenGCN框架具有有效性。 这篇博客如对论文有理解错误的地方请指出哦

这篇博客如对论文有理解错误的地方请指出哦